IT : 경제 : 뉴스 : 한겨레

포털 측 “사람들이 뉴스 편집 배열에 개입하지 않고”주장

“인공 지능의 중립성 ‘을 둘러싸고 세계적으로 논쟁 중

다음 창업자 “인공 지능이 객관적이라는 환상”

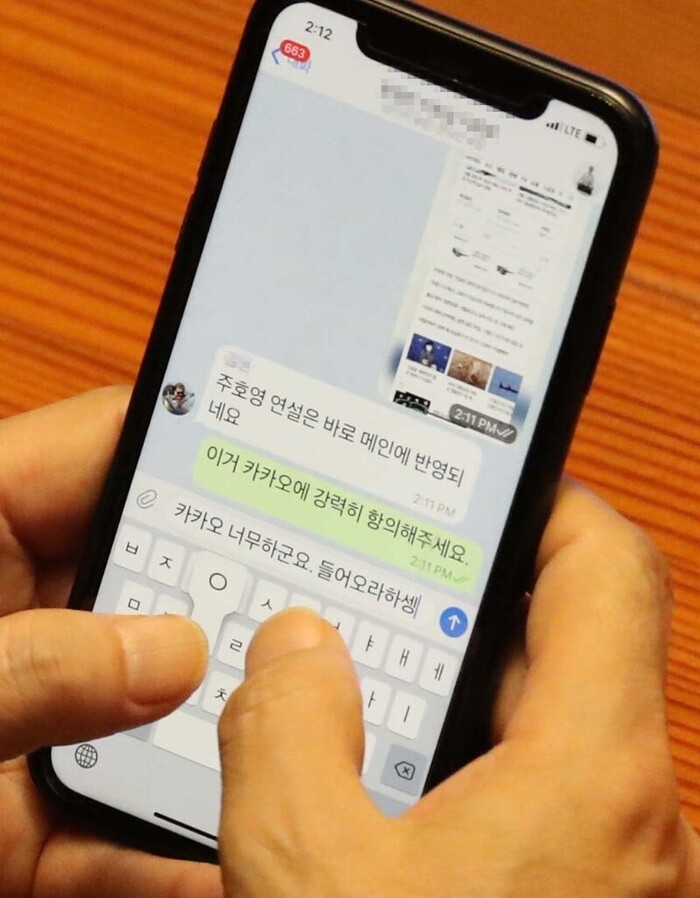

8 일 서울 영등포구 여의도 국회에서 열린 본회의에서 추가 민주당 윤요운챤 의원이 본인 의원실 직원과의 대화방에서 주호영 원내 대표의 교섭 단체 연설이 카카오 톡 메인에 소개되었다는 연락을 받았다 “카카오도하네요. 들어오는대로 파선”을 입력하고있다. 공동 취재 사진

윤요운챤 추가 민주당 의원이 포털 사이트 다음의 메인 뉴스와 관련 카카오를 압박하는 문자를 보낼 논의하면 다음과 같이 운영하는 카카오가 “인공 지능 (AI)가 뉴스 배열을 있다 “고 인위적으로 편집 가능성을 공식 부인했다. 그러나 인공 지능이 뉴스 배열도 포털 내부 인사가 “인위적으로”조정 여지가 전혀 없는지를두고 의문이 끊이지 않을뿐만 아니라, 인공 지능의 작업이 객관성과 중립성을 완전히 에 확보하고 있는지도 아직 논의 거리다.

■ 네이버 카카오 “뉴스 배열은 인공 지능 담당” 지난 8 일 윤 의원이 불을 붙여 “메인 뉴스 기사 노출 ‘논란과 관련, 카카오 측은”메인 화면에 보이는 뉴스는 2015 년부터 인공 지능이 자동 배열 “며”개인의 알고리즘을 기반으로하기 때문에 한 사람 한 사람에게 보이는 기사가 다르다 “고 말했다. 정치 뉴스를 즐겨 보는 소비자와 연예 뉴스를 좋아 방탄 소년단 (BTS) 팬에 공개 된 메인 화면이 서로 다른 의미이다. 카카오는 포털 다음의 카카오 톡 샤 붓 화면에서 뉴스 서비스를하고있다. 매일 언론에서 카카오로 전송 3 만 건 정도의 기사에서 중복 · 광고 기사와 선정적인 기사를 필터링 400 ~ 600 건 정도 추리는 작업을 인공 지능을 담당한다. 뉴스 배열은 이용자의 성별과 나이, 관심 등에 의한 추천 알고리즘에 의존한다는 것이 카카오 측의 설명이다. 임원 기 카카오 상무는 한 통화에서 “뉴스 편집 배열에 사람이 전혀 개입하지 않도록 시스템을 구축 한 것이 이미 2015 년이다. 사람이 개입하는 것 자체가 불가능한 구조”라고 말했다. 네이버도 2018 년 10 월부터 네이버 앱의 메인 화면에 뉴스가 나오지 않도록 개편했다. 메인 화면에서 오른쪽으로 한 번 넘겨 볼 수있는 뉴스 탭은 언론사가 직접 편집 한 기사를 보거나 인공 지능에 관심 뉴스를 자동으로 추천 (MY 뉴스)하도록 운영된다. 네이버 측은 “개인이 좋아할만한 기사는 물론, 편향 확증을 방지하기 위해 평소 잘 안보 기사도 추천 해 준다 같은 알고리즘 설계되어있다”고 설명했다.

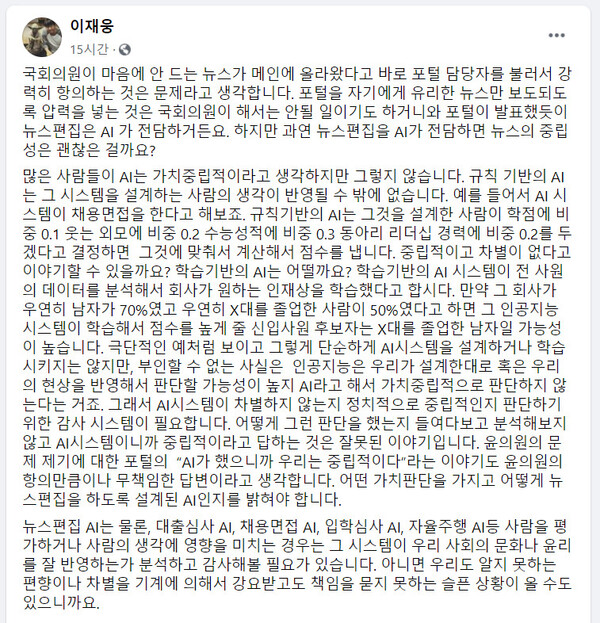

포털 사이트 다음 창업자 이재웅 전 소카 대표가 8 일 밤 자신의 Facebook의 게시물 ※ 이미지를 클릭하면 크게 볼 수 있습니다.

■ 인공 지능은 정말 가치 중립적인가? 그러나 업계에서는 인공 지능 장애 등의 ‘특별한’상황에서 사람이 인위적으로 뉴스 편집 배열에 개입하는 통로가 존재한다는 견해도있다. 예를 들어, 자연 재해 등 모든 사람에게 공개되어야 뉴스를 인공 지능을 여과 할 수 일어날 수 있기 때문이다. 이와 관련 임원 기 상무는 “시스템이 오류를 발생시켜 여과 된해야한다 기사가없는 여과면 기계를 수리한다. 오류 수정도 사람이 있다면이 없다”며 ” 시스템 적으로 불가능이라는 말은 그 일을 할 사람이 없다고 말한다 “고 못박았다. 이와는 별도로, 인공 지능 뉴스 배열이 과연 객관성과 중립성을 확보하고 있는지도 논의 거리다. 다음의 창업자 인 이재웅 전 소카 대표는 8 일 밤 Facebook의 “많은 사람들이 인공 지능은 가치 중립적이라고 생각하지만 그렇지 않다. 윤 의원의 문제 제기”인공 지능이 한 에서 우리는 중립 “고 답했다 포털도 윤 의원의 항의만큼 무책임하다”고 비판했다. 인공 지능 알고리즘 설계, 결국 사람이하는 것이다, 사람의 가치 판단에 영향을받을 수밖에 없다는 것이다. 인공 지능의 중립성에 관한 논의는 오래전부터 계속되어왔다. 소프트웨어 정책 연구소는 작년 4 월에 “인공 지능, 빅 데이터, 인터넷 등 디지털 기술의 부정적인 영향을 우려하는 목소리가 높아지고있다”며 “사람들이 인공 지능의 활용을 우려하고있는 최대의 이유는 인공 지능이 생각보다 공정하고 있지 않기 때문 “이라고 붙은 수있다. 인공 지능 전문가 인 미국 위스콘신 – 밀워키 대학의 마이클 짐머만 교수도 “인공 지능이 중립이라고 착각하기 쉽지만, 기존 사회의 편견과 불을 영원히 유지하기위한 수단이 될 것” 고 지적하고있다. 체민요운 기자 [email protected]

“워너비 음악의 선구자. 트래블러 홀릭. 총 좀비 팬. 자랑스러운 웹 애호가. 힙 스터 친화적 인 인터넷 광신자. 베이컨 전문가.”